يكي ديگر از اهداف دادهکاوی پديدهی خوشهبندي ميباشد، كه به فرآيند تقسيم مجموعهاي از دادهها (يا اشياء) به زير كلاسهايي با مفهوم خوشه اشاره دارد. يك خوشه، يك سري دادههاي مشابه ميباشد كه همانند يك گروه واحد رفتار ميكنند. لازم به ذكر است، خوشهبندي تاحدودی مشابه کلاسبندی است، با اين تفاوت كه كلاسها از پيشتعريفشده و معين نميباشند و عمل گروهبندي دادهها بدون نظارت انجام ميگيرد .

برخلاف کلاس بندی كه دادهها را براساس كلاسها تحليل مي كند،در خوشهبندي دادهها، بدون در نظر گرفتن برچسبهاي كلاس، تحليل می شوند ومعمولاً برچسب كلاسها دردادههاي آموزش مشخص نيست. خوشهبندي گاهي براي تعيين و توليد برچسب هايي برای داده ها بكار ميرود. داده های خوشهبندی شده بر اساس اصل ماكزيمم شباهت بين اعضای هر کلاس و مينيمم شباهت بين کلاسهای مختلف گروهبندی میشوند، يعنی خوشهها بهگونهای تنظيم میشوند که اشيای داخل هر خوشه بيشترين شباهت را با يكديگر داشته باشند. هر خوشه به عنوان يك كلاس ميباشد، كه قوانين هر کلاس، از خوشه متناظرش مشتق مي شوند .

روش ها و الگوريتم های بسياری برای خوشه بندی ارائه شده است. يکی از اين روش ها نگاشت خود سازمانده میباشد. در اين تحقيق از روش نگاشت خود سازمانده نوخاسته استفاده شده است. در ادامه اين بخش درباره SOM و ESOM توضيح مختصری داده می شود.

نگاشت خود سازمانده و نگاشت خود سازمانده نوخاسته

نگاشت خود سازمانده يک نوع از شبکه های عصبی مصنوعی است که به صورت نظارت نشده آموزش مي بيند و هدف آن ايجاد يک نمايش از فضای داده های ورودی به فضايی با ابعاد کمتر (معمولاً دو بعد) است. که به اين نمايش ابعاد پايين، نگاشت (يا نقشه) گفته می شود. نگاشت خود سازمانده با ساير شبکه های عصبی مصنوعی متفاوت است زيرا از يک تابع همسايگی به منظور حفظ خواص توپولوژيکی فضای ورودی استفاده می کند. اين مدل برای اولين بار توسط يک پروفسور فنلاندی به نام کوهونن ارائه شد، به همين دليل گاهی اوقات به نام نگاشت کوهونن شناخته می شود .

همانند بيشتر شبکه های عصبی مصنوعی SOM نيز در دو فاز آموزش و نگاشت اجرا می شود. در فاز آموزش، نگاشت (يا نقشه) با استفاده از نمونه های ورودی ساخته می شود. آموزش يک فرآيند رقابتی است که به نام تدريج بردار نيز شناخته می شود. در فاز نگاشت بردارهای ورودی جديد به طور خودکار کلاسبندی می شوند.

نگاشت خود سازمانده از اجزايی به نام نرون تشکيل می شود. هر نرون با يک بردار وزن با ابعادی، برابر با ابعاد داده ورودی و موقعيتش در فضای نگاشت مشخص می شود. نرونها معمولاً در يک فضای منظم به شکل يک شبکه شش ضلعی يا مستطيل شکل چيده می شوند. همان طور که پيش از اين اشاره شد، نگاشت خود سازمانده توصيفی از فضای ورودی با ابعاد بالا به نگاشتی با ابعاد پايين است. SOM برای قرار دادن يک بردار از فضای داده ورودی در نگاشت، نرونی که نزديکترين بردار وزن به فضای داده ورودی را دارد، پيدا می کند، پس از مشخص شدن نزديکترين نرون، مقدار بردار وزن نرون، با توجه به داده ورودی، به روزرسانی می شود. در اين روش استفاده از ماتريسU بسيار متعارف است. مقدار يک نرون در ماتريسU، ميانگين فاصله بين نرون و نزديکترين همسايه هايش است. در يک شبکه مربعی 4 يا 8 همسايه و در يک شبکه شش ضلعی 6 همسايه در نظر گرفته می شوند. از جمله توسعه های مفيدی که در اين نوع شبکه ها داده شده است، میتوان به شبکه های چنبره ای اشاره کرد. در اين شبکه ها لبه های مخالف به يکديگر متصل شده اند و از تعداد زيادی نرون استفاده می کنند .

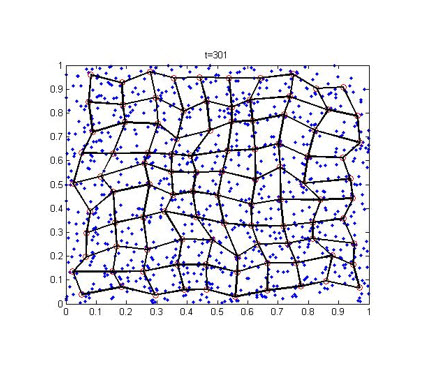

نشان داده شده است که نگاشت های خود سازمانده، با تعداد کمی نرون همانند روش k ميانگين رفتار می کنند، درحاليکه شبکه های خود سازمانده بزرگ داده ها را به روشی که مشخصات توپولوژيکی اصلی حفظ شوند، مرتب می کنند. اين ويژگی باعث مطرح شدن شبکه های ESOM شد. تفاوت ميان ESOM و SOM سنتی اين است که ESOM از تعداد بسيار زيادی (حداقل چند هزار) نرون استفاده می کند. بنابراين ESOM برای ايجاد يک ديد کلی از ساختار داده های پراکنده و دارای ابعاد بالا مناسبتر است. در ESOMها ويژگی داده ها بهتر مشخص می شود، بنابراين از ESOMها که هزاران نرون دارند، میتوان برای خوشه بندی مناسبتر داده ها استفاده کرد.

ناب لرنینگ |

بزرگترین بانک اطلاعاتی پروژه های دانشجویی

ناب لرنینگ |

بزرگترین بانک اطلاعاتی پروژه های دانشجویی